编者按

泪河高度能够反映泪腺分泌量,是评估干眼患者病情的重要指标之一。常见的泪河高度检测方法有基于数字图像处理技术的传统方法和基于泪河图像的人工测量。前者存在易受眼睛组织干扰、图像拍摄角度、眨眼等因素影响的问题,后者会因时间和人工成本的影响,降低工作效率。因此我们提出一种基于深度学习的泪河高度检测方法。

这种泪河高度检测方法充分利用了 MobileNetV3 和 DFANet 两个深度卷积神经网络的优势和优异的网络性能,并基于深度模型设计了一种新的泪河高度检测方法。这种方法在实验测试中取得了优异效果,并且实验结果显示,无论在时间还是算法方面,各模块的指标性能均优于传统方法。

该文章于近日发表在2022年第38卷第20期《计算机应用文摘》上。

方法

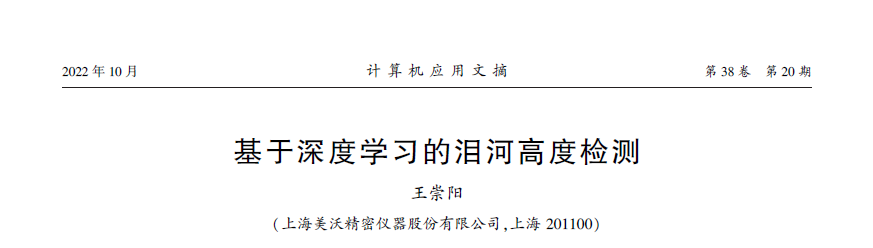

01 泪河高度检测的总体框架

首先将获取到得人眼图像输入到基于 MobileNetV3 的睁闭眼识别网络,筛选出有效的睁眼图像,然后用以 MobileNetV3 为骨干网络的泪河粗定位网络进行回归定位,之后裁剪出泪河区域图像,随后将裁剪图像输入基于 DFANet 的快速分割网络,得到更加精细的泪河区域分割图。最后,利用泪河边缘修正模块和泪河高度计算模块,对泪河区域分割图进行后处理,并结合原人眼图像检测泪河实际高度。

泪河高度检测方法总体框架

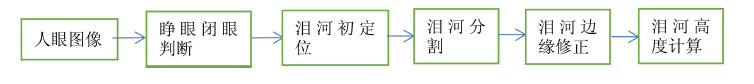

02 睁闭眼分类识别网络

由于待检测的人眼图像分为闭眼和睁眼两类,因此在检测泪河高度之前,需有效识别睁眼图像,提高算法执行效率。本文使用 MobileNetV3 深度网络进行识别。

在 MobileNetV3 网络结构的基础上,保持骨干网络不变,修改最后的输出层,即将全连接层的输出结点数设为2,使用具有3通道的人眼彩色图像作为输入图像,最终有效识别是否为睁眼图像。

03 泪河区域粗定位网络

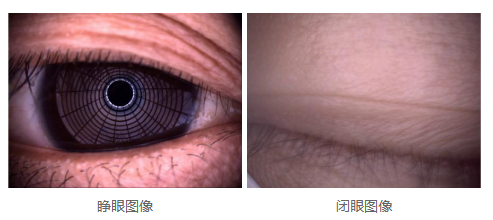

对比传统泪河高度检测方法,本方法基于深度分割网络,实行逐像素自动分类,避免人工识别带来的人为误差,同时使用深度网络充分学习训练样本的属性特征,可以快速而准确地分割出期望的泪河二值图。

本方法使用 DFANet 将输入的图像进行多尺度特征传播,大幅减少参数量的同时获得足够的感受,并在速度和分割性能之间很好的进行了平衡。

用于泪河区域分割的 DFANet 网络结构图

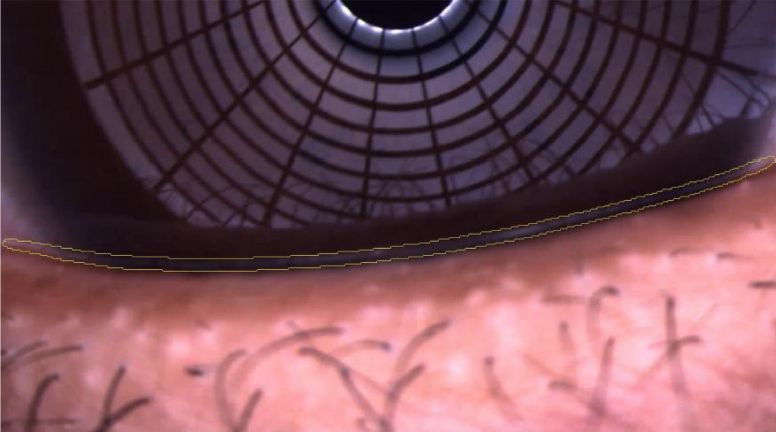

04 泪河边缘修正模块

本模块利用 Canny 算法提取泪河区域的边缘,对于获取到的泪河上下边缘,在每个位置竖直方向的10个像素范围内寻找梯度最大的位置,并用此位置修正原泪河边缘。

基于边缘修正模块的泪河图像

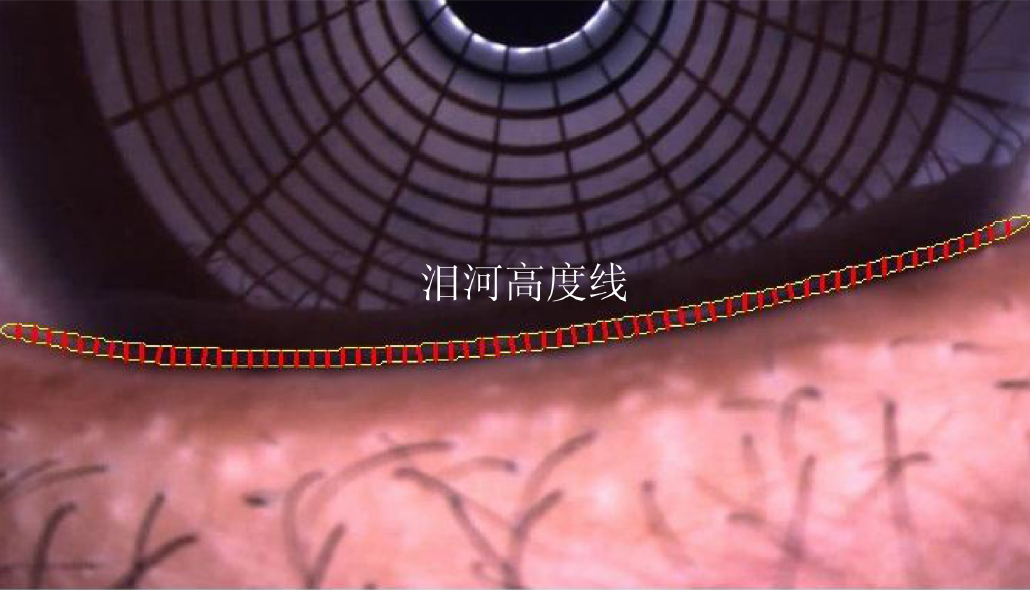

05 泪河高度计算模块

泪河边缘经过修正后,可以得到更准确的边缘界限,该模块会计算泪河下边缘的每个位置和径向方向,并寻找此方向与泪河上边缘的交点。

人眼图像泪河高度图

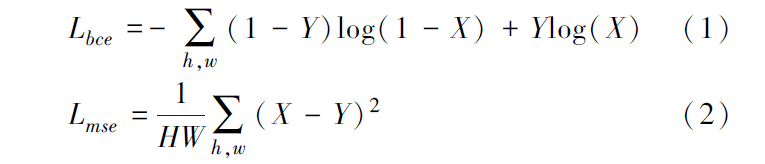

06 损失函数

为了优化深度网络中的模型参数,本文引入了二分类交叉熵损失函数用于分类网络和分割网络,又引入了均值平方差函数用于粗定位网络中的回归损失计算。

注:Lbce 表示二分类交叉熵损失函数,Lmse 表示均方差损失函数。式(1)和式(2)中X与Y分别表示网络输出值和所对应的标签值,h与w表示图像像素坐标,H与W表示图像大小。

实验和分析

为了验证本文提出的基于深度学习的泪河高度检测方法,下面会进行对比实验和分析以验证本文方法的优势和有效性。

01 数据集及预处理

为了搜集人眼数据集对本文深度学习模型进行训练,采集机器选用上海美沃眼表检查系统,该设备具有宽动态范围、高分辨率、高灵敏度、自动曝光、自动白平衡等特点,能够很好地拍摄高画质图像。本次论证搜集到人眼图片总共7470张,其中睁眼图像有5790张,闭眼图像有1680张,分辨率达到2592*1944。

02 训练参数设置和评价指标

睁闭眼分类识别网络和泪河区域粗定位网络使用相同的实验设置:将搭建的 MobileNetV3 模型在 IMAGENET 数据集上的训练权值作为初始权值。数据集按6:2:2比例分成训练集、验证集和测试集,初始学习率0.01,在第20轮、第40轮分别将学习率降低10倍,训练60轮。泪河区域分割网络所使用的实验设置:DFANet 在 Cityscapes 数据集上的训练权值作为初始权值。数据集按6:2:2比例分成训练集、验证集和测试集,初始学习率为0.01,在第30轮,第60轮分别将学习率降低10倍,训练80轮。上述实验都选取训练集和验证集 loss 值相差最小的训练权值作为训练结果。

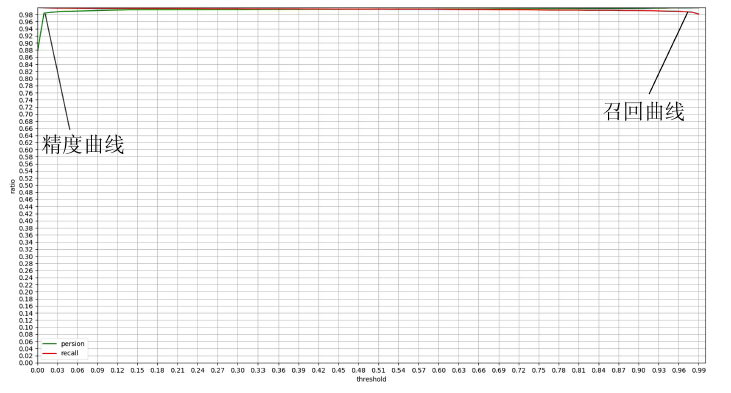

为了评估算法实效性均采用了时间指标;睁闭眼分类网络使用睁眼的精度、召回指标;泪河粗定位网络使用欧式距离指标;泪河分割网络使用交并比即 IOU 指标。

03 实验结果和分析

睁眼闭眼分类评价结果如下图所示,横坐标为概率阈值,纵坐标为百分比。当阈值为0.7时,睁眼类的精度为99.5%,召回为99.1%,可得出该模型分辨准确。且该分类器在一般 Intel I5处理器上的单张图像运行时间为25ms。

睁眼闭眼分类性能评价

泪河粗定位网络计算的平均欧式距离为5.3个像素,说明预测点能够很好地指示泪河左右两个端点。该模块在一 般 Intel I5处理器上单张图像运行时间为23ms。

泪河区域分割网络计算得出预测区域和真值区域的 IOU 为91.6%,表明预测区域和实际位置基本一致。该模块在一般 Intel I5处理器上的单张图像运行时间为31ms。

通过一系列的操作,得到的计算结果和人工手动测量结果只相差0.8个像素,并且总运行时间只有90ms。

总结

基于深度学习的泪河高度计算方法实现了全自动辅助测量,可替代人工手动标记,提高临床检查效率。